就在今天(11 月 3 日)凌晨,IT之家 微信 iOS 端收到了 8.0.54 测试版更新

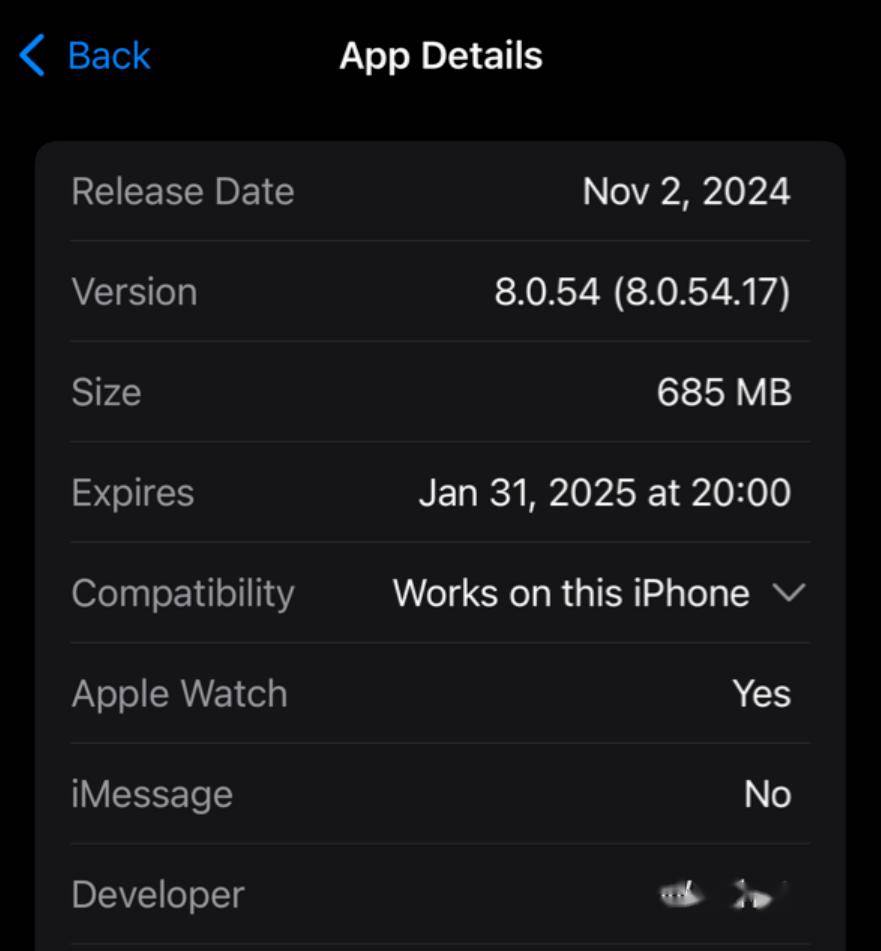

从他晒出的截图显示,此次更新的版本是微信在 11 月 2 日推送的,大小为 685MB。

鉴于微信 iOS 每次测试版放出的尝鲜数量有限,小编火速打开微信想抢个名额,结果发现了反常之处 ——

这次测试版,虽然依旧采用邀请邮件的方式, 但是没有分享链接的选项 ,因此无法在 TestFlight 中下载,属于纯看运气。

另外,微信在前端时间还上架了 Windows 端的 4.0.0 测试版下载链接,并且也一反常态。

不仅不像之前那般需要提前申请资格才能使用,并且在安装后也不会覆盖已有微信。

更关键的是,作为 PC 端的 4.0 大版本迭代, 更新力度那叫一个又大又多 。

接下来,小编就向各位好好说说 iOS/Windows 双端最新测试版的更新情况。

视频通话界面调整(iOS)

在此次 iOS 8.0.54 测试版中,微信对视频通话界面进行了改动。

在之前的版本中,当用户和好友处于视频通话时, 界面下方的选项分为两行 。

第一行为麦克风、扬声器和摄像头开关,第二行则为模糊背景和翻转镜头的图标。

而在新测试版中, 微信将两行选项合二为一 。

据博主 @大巫先生 发布的截图显示,麦克风、扬声器、摄像头、模糊背景、翻转变为从左到右依次排列。

并且模糊背景和翻转还双双有了文字名称,后者更是换了新图标。

对比改动前后的两个界面样式,虽略显新奇,但新界面中的图标太小且拥挤。

当然了,新 / 旧两种排列形式哪一个更顺眼,是见仁见智的事情。

以及从目前打探到的情报来看, 本次 iOS 8.0.54 测试版的改动仅此一处 ,但不排除后续测试和正式版中会引入更多新功能和调整。

深色模式终至(Windows)

等了好久终于等到今天...... 在微信 Windows 4.0.0 测试版中,广大用户渴望的深色模式,可算是来了。

依次点击左下角的“三 - 设置 - 同样”,可以看到“外观的选项,默认为浅色模式。

点击后,会弹出 跟随系统、浅色模式、深色模式 三个选项,可按喜好替换。

字体大小可调整

也是一个让许多用户等待很久的功能,在微信 Windows 4.0.0 测试版中, 字体的大小可手动调整了 。

设置的选项,恰恰位于调整外观模式的下方,共有六种大小,左右滑动即可调整。

界面设计焕新

不只是新增了深色模式,微信 Windows 4.0.0 测试版的整体界面流露着一种陌生感,只因

最显而易见的有边框由直角变为圆角和编辑栏区域底色由深变浅, 观感变得更为清爽简约 。

较为细节的有好友头像四角变圆弧、右键菜单边框圆润化和截图边框调整。

通讯录界面优化

在之前的版本中,Windows 的通讯录界面和手机端一样“简单粗暴”,会根据首字母顺序直接排列并展示好友。

但是在 4.0.0 测试版中, 通讯录界面则按照群聊、公众号、企业微信联系人、联系人分类 。

各个类别会显示数量,具体的联系人折叠在内,使界面变得很是清爽。

联系人资料界面可看视频号

在优化了通讯录界面的同时,Windows 4.0.0 测试版的联系人资料界面, 现可看视频号 。

但凡好友在视频号上发布了公开作品,那么就能在其资料界面中查看。

可惜的是,虽然增加了视频号,但朋友圈还是不能看且无法发。

服务号折叠

继手机端“折了再折”之后,服务号折叠这股风终究还是吹到了 Windows 上。

在 4.0.0 测试版中, 所有的服务号消息均折叠到“服务号”板块中 ,不再单独在聊天列表显示。

比起在手端可能会带来不便,在 PC 端倒是真让杂乱的列表界面变得简约。

群聊取消拍一拍

不知是出于何种缘故,在 Windows 4.0.0 测试版中, 微信群聊不支持拍一拍了 。

右击好友的头像,只有 @,拍一拍消失不见。

聊天记录可拉动多选

一处能提供便捷的操作,在 Windows 4.0.0 测试版中, 可以拉动多选聊天记录 ,然后执行转发、保存、收藏、删除操作。

对比之前“右击 + 多选 + 逐条选择”的方式,减少了操作繁琐性。

搜索框界面优化

在以前的版本中,点击左上角的搜索框,只会弹出“搜索网络结果”一个选项。

而在 Windows 4.0.0 测试版中,点击搜索框,在弹出搜索网络结果的同时, 又多了一个“搜索聊天记录” ,便于用户查地聊天记录。

多个功能不可用

在此次 Windows 4.0.0 测试版中,有多个操作暂时不可用。

比如浮窗,原本位于左下角的浮窗按钮消失,因此无法查看在手机端保留的链接;再比如转账,目前的版本不支持查看和接收转账。

此外,包括钉在最上方、清理缓存、呼出快捷键、拖动保存图片文件至桌面,这些尚且都无法使用。

总结

以上就是微信 iOS 8.0.54 和 Windows 4.0.0 测试版的更新详情了,其实 PC 端多个场景的动画亦有优化,但很难描述,需要各位亲身去体验效果。

需要注意的是,在首度登录 4.0.0 测试版时,可以选择从原微信客户端导入聊天记录。

但是, 当下无法修改文件储存位置 ,介意的家友请谨慎更新。

另外, 微信纯血鸿蒙 1.0.1.34 版现已上线华为应用商店尝鲜区 ,增加了个人名片、位置等功能,同时支持了各类文件的收取、查看功能。

目前,微信鸿蒙原生版已包含基础社交通讯、音视频通话、朋友圈、微信支付的二维码收 / 付款等功能,功能正在逐步完善。

作为 Windows 端的大版本更新,4.0.0 的测试版力度肉眼可见。

此情此景, 不禁让小编对 iOS / 安卓的 9.0 更翘首以盼 ,很期待微信团队的操作。

2024 年还剩不到两个月,不知我们能否看到微信 9.0 闪亮登场。

大家在IT之家微信号回复“ 微信 ”两字,即可获取当前最新官方内部版微信下载。

《T1 战胜 BLG 获得英雄联盟 S14 全球总冠军